为什么不同人做出的 Skill 差别那么大

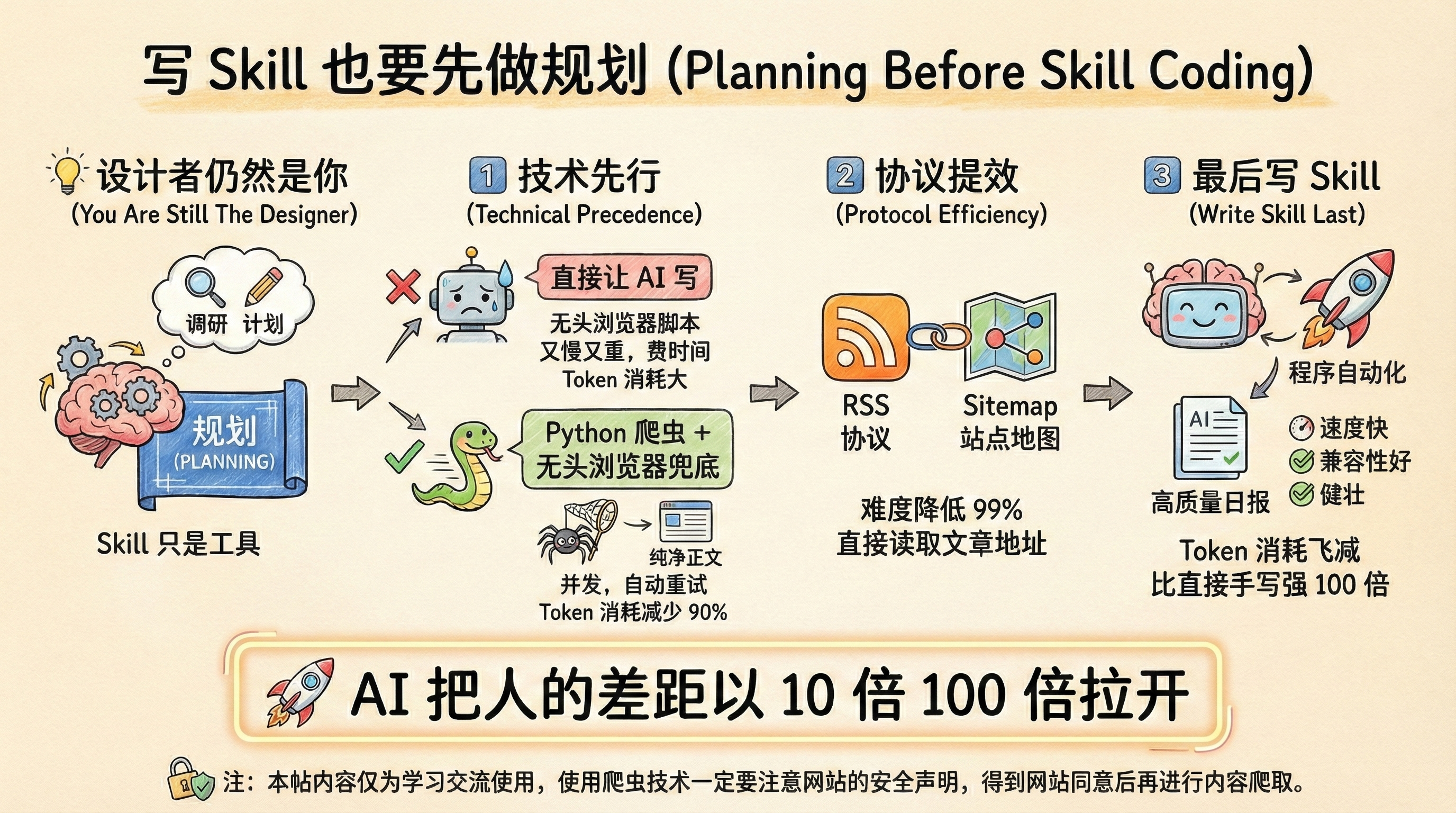

写 Skill 也要先做规划,Skill 只是工具,设计者仍然是你。

同样是用 Skill 设计一个功能,别人的功能稳定性、速度、Token 消耗可能都要比你的好很多倍。

举一个日报抓取的例子:你要从 20 个数据源中抓取文章,并且用 AI 筛掉不需要的内容,最终聚合成一份日报。

如果你直接让 AI 去写 Skill,大概率是它写了一个无头浏览器脚本帮你抓取,又慢又重,又费时间。

但是如果你在写 Skill 前,先让 AI 帮你做一份技术方案调研,可行性和稳定性将会大大增加。

仍然以日报抓取为例,先和 AI 聊清楚需求之后,它给你的计划可能是这样的:

1. 技术先行

爬取工具方面采用:Python 爬虫抓取 + 无头浏览器。

Python 在爬虫领域本身就是使用最广泛的语言,所以在它的生态中积累了非常多的优秀的爬虫库。

这些库可以帮你:并发爬取、自动重试、清除所有的网页结构,只保留网页正文。

这样一来,任何网站用这个爬虫脚本跑一遍,就已经能拿到网页正文了,这比直接用 AI 直接减少了 90% 的 Token 消耗。

当然,这样不够保险,因为有些网站会防爬,所以兜底情况下用无头浏览器去爬取网站,再用 AI 总结网页内容。

2. 协议提效

很多内容资讯性的网站会提供 RSS 协议和 Sitemap 站点地图。

RSS 协议是为了方便很多阅读器自动读取网站更新的内容。

Sitemap 站点地图则是利于搜索引擎的 SEO。

如果你爬取的任何一个网站,具有这两个东西的其中一个,那么你读取它们内容的难度将会降低 99%。

因为它们会在协议中直接告诉你所有的文章地址,然后使用爬虫直接读取即可。

3. 最后写 Skill

当你把这个计划,提交给 AI 之后,AI 就会帮你生成一个速度快、兼容性好、又健壮的日报抓取程序了。

这个方案帮你去掉了 90% 的 AI 工作,都变成了程序自动化,这样你的速度飞快、Token 消耗飞减。

这要比 AI 直接手写代码,强 100 倍,因为这里面会用到的技术方案都是历久弥新的干货,很多网站的拦截,爬虫库自动就帮你处理了。

然后 Skill 中会直接调用这个程序,收到结果之后,AI 再通过你预先的偏好,帮你筛选出一份高质量的结果。

为什么推上很多大佬说,AI 把人的差距以 10 倍 100 倍的差距拉开,这就是原因。

注:本帖内容仅为学习交流使用,使用爬虫技术一定要注意网站的安全声明,得到网站同意后再进行内容爬取。